Vom Datengrab zum "2nd Brain"

In einem meiner ersten Artikel in diesem Blog, Episode 10.2 - Fishing knowledge in a sea of words without drowning in it 🙂, schloss ich mit der Frage ab: Wenn es nicht um die schiere Menge an Daten geht (der „Bohrer“), sondern um den konkreten Erkenntnisgewinn (das „Loch in der Wand“) – was sind dann eigentlich präzise, nutzbare Informationen, und wie können wir sie für uns erzeugen?

Eine vielversprechende Antwort auf den Umgang mit dieser Informationsflut bietet das Konzept des „Second Brain“ (Zweites Gehirn) im Rahmen des persönlichen Wissensmanagements (Personal Knowledge Management, kurz PKM).

Von der Karteikarte zur digitalen Vernetzung: Zettelkasten und Second Brain

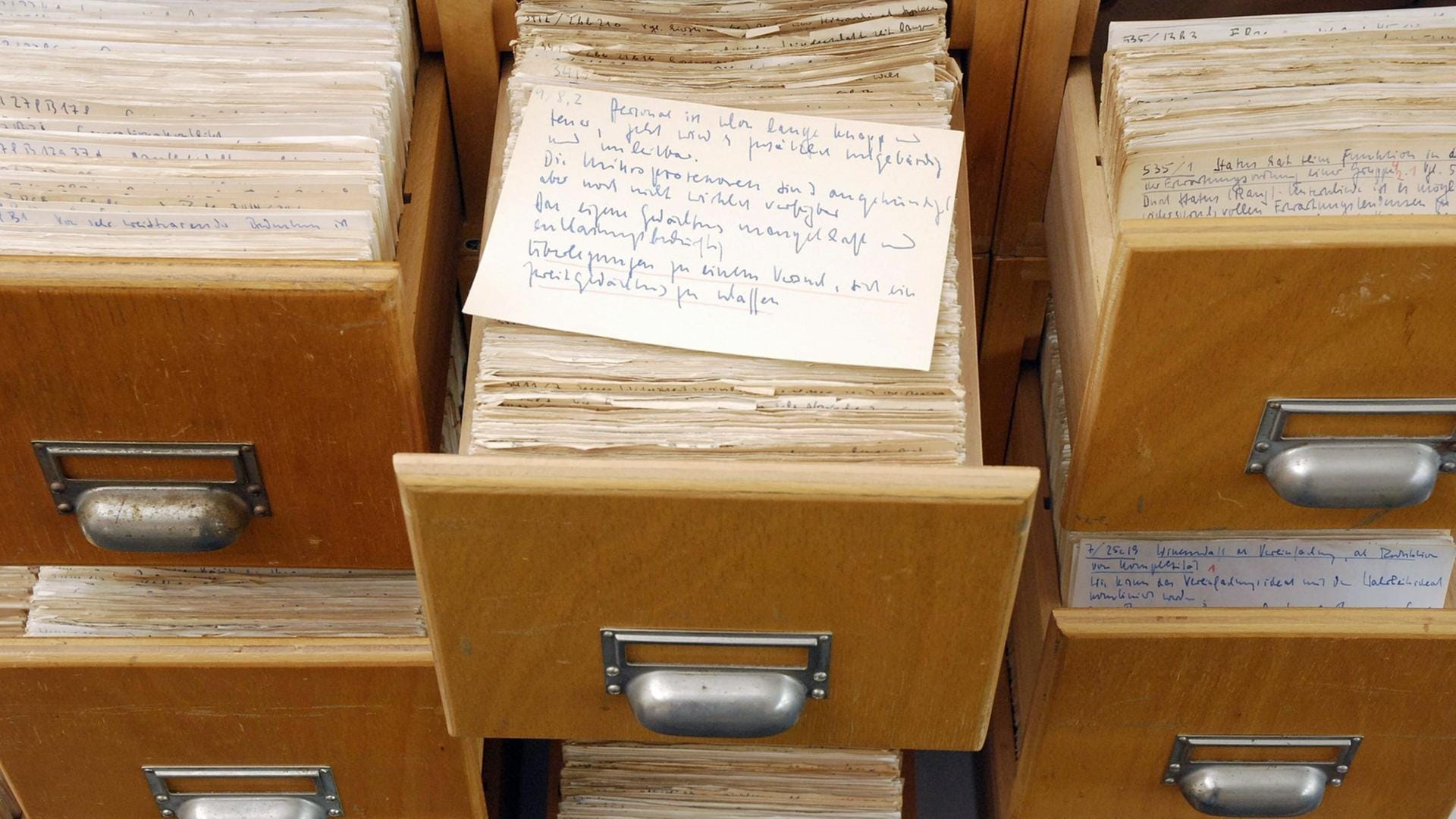

Der Begriff des „Second Brain“ beschreibt ein systematisches Vorgehen, um persönliches Wissen zu sammeln, zu organisieren und wieder abrufbar zu machen. Die grundlegende Idee dahinter ist jedoch keineswegs neu. Sie lässt sich als moderne, digitale Weiterentwicklung des klassischen „Zettelkasten“-Prinzips verstehen, das vor allem durch den Soziologen Niklas Luhmann bekannt wurde.

Luhmann hielt seine Gedanken und Lesefrüchte auf physischen Karteikarten fest und vernetzte sie durch ein ausgeklügeltes Nummernsystem miteinander. Sein Ziel war es, Querverbindungen zwischen völlig unterschiedlichen Themengebieten sichtbar zu machen.

Das Second Brain überträgt diesen Ansatz in die digitale Welt. Beide Konzepte teilen ein zentrales Anliegen: Sie sollen nicht als starres Nachschlagewerk dienen, sondern als ein wachsendes Netzwerk von Ideen, in dem Informationen so abgelegt und verknüpft werden, dass sie später das eigene Denken, Schreiben und Entscheiden unterstützen.

Die Basis: Das Auslagern von Informationen

Die Grundidee eines Second Brains ist recht pragmatisch: Unser biologisches Gehirn ist bemerkenswert gut darin, Muster zu erkennen, Konzepte zu verstehen und kreativ zu sein. Es stößt jedoch an seine Grenzen, wenn es darum geht, große Mengen an unstrukturierten Informationen langfristig und fehlerfrei abzuspeichern.

Ein Second Brain lagert diese Speicherfunktion in digitale Werkzeuge aus. Man sammelt dort Lesezeichen, Artikel, Notizen aus Meetings oder eigene Gedanken. So entsteht zunächst ein zentraler Ort für alles, was einem wichtig erscheint.

Die Grenze des reinen Sammelns

An diesem Punkt entsteht jedoch häufig ein konzeptionelles Missverständnis. Eine reine Datensammlung, so gut sie auch strukturiert sein mag, reicht in der Regel nicht aus, um einen echten Mehrwert zu schaffen. Ein Archiv allein ist noch kein "Gehirn". Wenn wir nur Informationen ablegen, betreiben wir im Grunde lediglich ein strukturiertes Horten von Daten.

Um ein PKM-System tatsächlich zu einem Second Brain auszubauen, bedarf es einer weiteren, entscheidenden Komponente: der Datenverarbeitungsschicht. Es braucht Mechanismen, die dabei helfen, aus der gesammelten Rohmasse zum exakt richtigen Zeitpunkt die relevante Information zu „destillieren“.

KI als Verarbeitungsschicht

Hier zeigt sich ein besonders sinnvoller Anwendungsfall für Künstliche Intelligenz. Während das PKM die Datenspeicherschicht bildet, können KI-Werkzeuge die aktive Verarbeitung übernehmen.

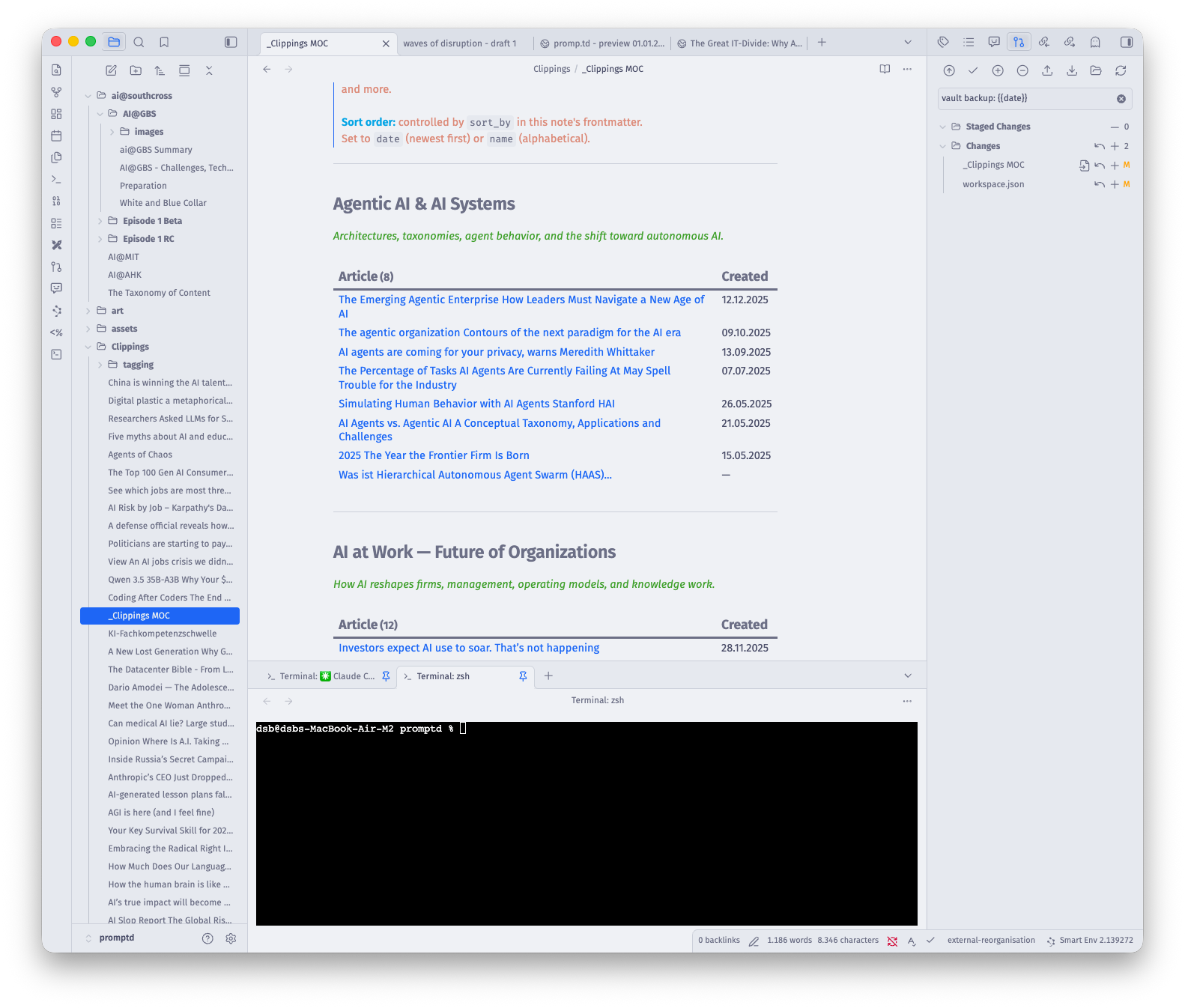

Bis vor Kurzem hätte der Aufbau einer solchen Verarbeitungsschicht tiefgehende Programmierkenntnisse erfordert. Man hätte Datenbankabfragen schreiben oder Such-Algorithmen programmieren müssen, um die eigenen Notizen intelligent zu filtern. Heute bieten moderne KI-gestützte Entwicklungsumgebungen und Agenten – wie beispielsweise Claude Code – wesentlich zugänglichere Lösungswege.

"Destillierlogiken" in natürlicher Sprache

Mit diesen Werkzeugen ist es möglich, spezifische "Destillierlogiken" zu erstellen, um die gewünschten Informationen aus den eigenen Datensammlungen zu extrahieren. Der didaktische Paradigmenwechsel dabei ist: Es sind dafür keine klassischen Programmierkenntnisse mehr zwingend erforderlich.

Es genügt meist, diese Logiken präzise in Textform (also in natürlicher Sprache) zu formulieren. Man kann dem System beispielsweise beschreiben:

„Gehe meine Notizen aus dem letzten Monat durch, suche alle Textstellen heraus, die sich mit Technologie-Ethik befassen, und fasse die drei am häufigsten genannten Argumente zusammen.“

Die KI übersetzt diese textlichen Anweisungen in ausführbare Skripte oder Suchvorgänge, wendet sie auf die lokale Datensammlung an und gibt das destillierte Wissen, wiederum als Text, zurück.

Fazit: Die Optimierung des "Knowledge Worker"-Prozesses

Ein Second Brain entsteht also oft erst in der Kombination aus einer gut gepflegten Datensammlung und einer intelligenten, sprachlich steuerbaren Verarbeitungsschicht. Dieser Ansatz bietet eine sehr praktische Methode, um die eigenen unstrukturierten Daten wertvoller zu machen.

So nähern wir uns einer Lösung für die Zettabyte-Ära im persönlichen Rahmen: Wir schaffen uns ein System, mit dem wir im Meer der Wörter gezielt die Informationen fischen können, die wir gerade benötigen – ohne in der reinen Masse der Daten zu ertrinken.

Als eifriger Datensammler habe ich das letzte Jahr damit verbracht, diese Methodik zu verfeinern, und werde in Folgebeiträgen meine Vorgehensweise darstellen und aufzeigen, wie ich mein "Second Brain" aufgebaut habe.

Live long and prosper 😉🖖